この記事は、【Obsidian実践ガイド】シリーズの一部です。

シリーズ全体は、まとめページから確認できます。

ObsidianでAIプラグインを使ってみたいと思ったとき、

最初に迷いやすいのが「どのAI接続方法を選ぶべきか」です。

プラグイン自体は無料でも、裏側で使うAIモデルの接続先によって、

料金・速度・使い勝手・データの扱い方が大きく変わります。

私自身も、最初は「とりあえず使えればOK」と考えていましたが、

実際に運用し始めると、ここを最初に整理しておくかどうかで

後の快適さがかなり変わると感じました。

この記事では、ObsidianでAIを使うときの代表的な3方式を整理します。

- 無料API枠を使う方法(例: Gemini API)

- 有料APIを使う方法(例: OpenAI / Anthropic)

- ローカルLLMを使う方法(例: Ollama)

この記事を読むと、次のことが分かります。

- 3方式の違い(料金・導入難易度・セキュリティ・性能の傾向)

- 自分の用途に合う接続方式の選び方

- まず試すときの最小構成

第14回は「土台づくり」の回です。

個別プラグインの詳しい設定に入る前に、

まずは接続方式の全体像をここで押さえていきます。

用語を最初に3つだけ整理

初心者の方向けに、最初に出てくる用語を短く整理しておきます。

- API: 外部サービスとデータをやり取りするための接続口

- LLM: 文章生成や要約が得意な大規模言語モデル

- 従量課金: 使った分だけ料金が発生する課金方式

まず結論:最初は「無料API枠」から始めるのが無難です

はじめてObsidian×生成AIを試す場合、

私は無料API枠から始めるのが最も失敗しにくいと考えています。

理由はシンプルで、初期コストをかけずに

「自分の使い方にAIが本当に合うか」を検証できるからです。

いきなり有料APIで運用を始めると、

試行錯誤の段階でも課金が発生しやすくなります。

一方でローカルLLMは、ランニングコストの面では有利ですが、

PCスペックや初期設定のハードルがあります。

まずは無料APIで操作感をつかみ、

必要に応じて有料APIまたはローカルLLMへ移行する流れが、

実運用では安定しやすいです。

無料API・有料API・ローカルLLMの違い

無料API枠を使う方法(初心者向け)

Google Gemini APIなどには、無料で試せる枠があります。

この方式は、次のような読者に向いています。

- まずは費用ゼロで始めたい

- AIプラグインの基本操作を覚えたい

- 長文生成よりも、要約や言い換えなどの軽い用途から試したい

メリットは、導入ハードルが低く、すぐ検証できることです。

注意点として、無料枠には回数や利用量の制限があるため、利用時間帯や使い方によっては制限に当たることがあります。

有料APIを使う方法(性能重視向け)

OpenAI(ChatGPTのGPT-4o系)やAnthropic(Claude 3.5 Sonnet系)などのAPIを使う方法です。

利用できるモデル名は時期によって更新されるため、実際に選ぶ際は各公式の最新情報を確認してください。

この方式は、次のような読者に向いています。

- 応答品質や安定性を重視したい

- ブログ下書きや長文編集など、利用頻度が高い

- 業務レベルで継続運用したい

メリットは、モデル選択の幅が広く、用途ごとに最適化しやすいことです。

注意点は従量課金です。

特に、長文を何度も再生成する使い方ではコストが増えやすいため、事前に上限管理を決めておくと安心です。

ローカルLLMを使う方法(セキュリティ重視向け)

Ollamaなどを使って、自分のPC上でAIモデルを実行する方式です。

この方式は、次のような読者に向いています。

- データを外部クラウドへ送信したくない

- 月額や従量課金なしで運用したい

- ローカル環境の調整に抵抗がない

メリットは、外部送信を抑えた運用がしやすく、コスト管理が明確なことです。

注意点は、PCスペックの影響を強く受ける点です。

モデルによっては動作が重く、応答速度や品質に差が出ます。

ローカルLLMを選ぶ場合は、以下の番外編を先に読むと導入しやすくなります。

Obsidian生成AIの比較表

ざっくり比較すると、次のようになります。

| 比較項目 | 無料API枠 | 有料API | ローカルLLM |

|---|---|---|---|

| 初期費用 | ほぼ不要 | ほぼ不要 | PC環境の準備が必要 |

| 継続コスト | 原則無料(制限あり) | 従量課金 | 追加課金なし(電力・機材コストは別) |

| 導入難易度 | 低い | 低〜中 | 中〜高 |

| 応答品質の安定性 | 中(制限の影響あり) | 高い傾向 | モデルとPC依存 |

| データ外部送信 | あり | あり | なし運用が可能 |

| おすすめ対象 | 初心者 | 継続運用者 | セキュリティ重視・中上級者 |

Obsidian生成AIの選び方

迷ったときは、次の3つの質問で判断すると整理しやすいです。

- まず費用ゼロで検証したいですか。

- 応答品質を最優先にしますか。

- ノート内容を外部送信せずに運用したいですか。

判断の目安は以下です。

- 1が最優先なら無料API枠

- 2が最優先なら有料API

- 3が最優先ならローカルLLM

実際には、最初は無料APIで始め、用途が固まったら有料APIやローカルLLMに分岐する運用が現実的です。

Text GeneratorでGemini APIキーを設定する手順(無料API)

ここでは、プラグインの機能解説には踏み込まず、まず「接続して1回動かす」ことに絞って説明します。

今回の例では、Obsidianプラグインは Text Generator を使います。

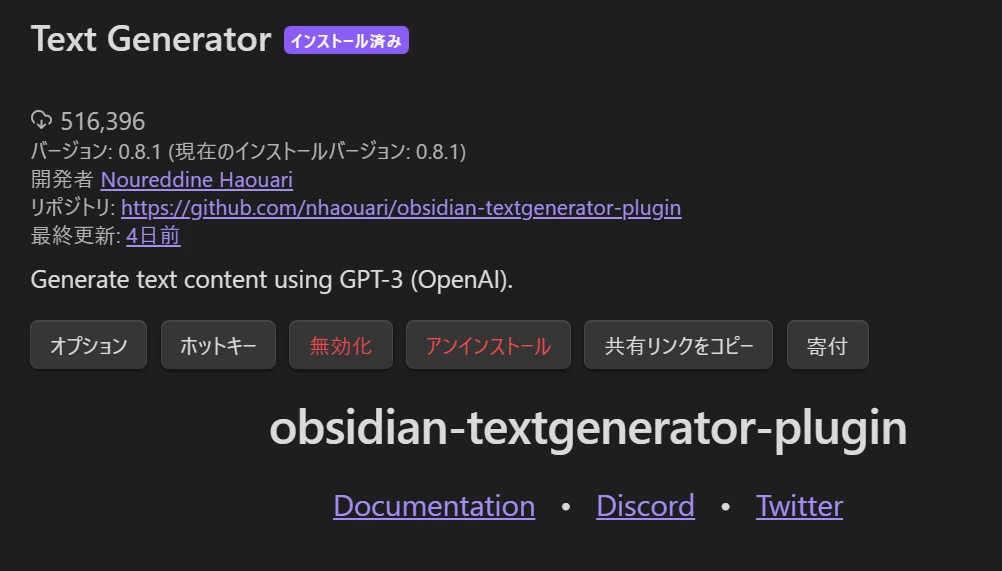

手順1: Text Generatorをインストールして有効化する

- Obsidianの

設定を開きます。 コミュニティプラグインを開き、閲覧を有効化します。Text Generatorを検索してインストールし、有効化します。

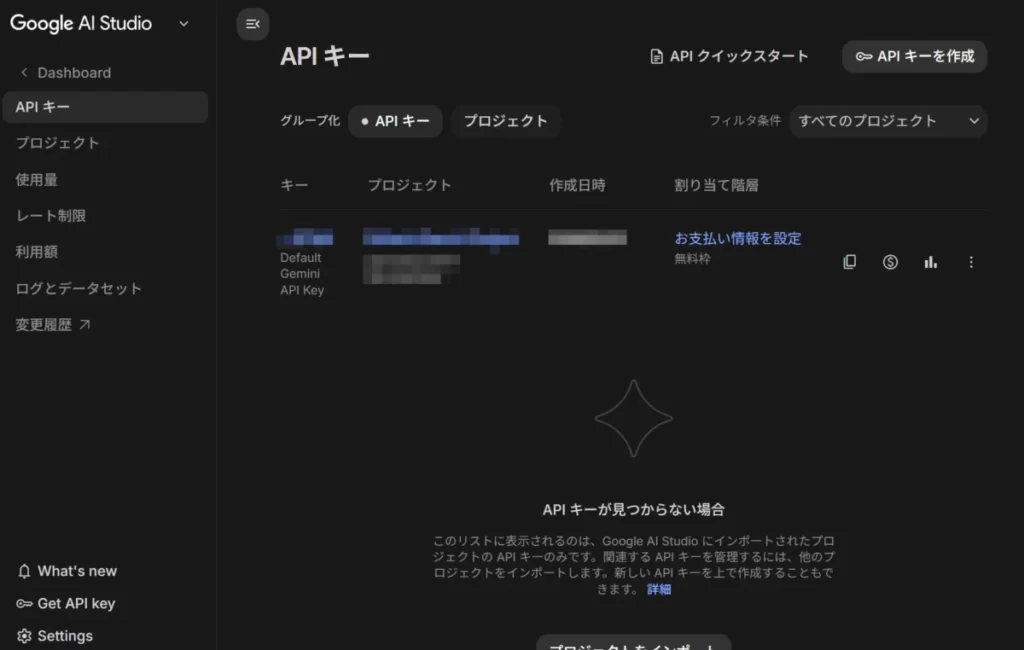

手順2: Gemini APIキーを発行する

- Google AI Studio(Gemini APIの管理画面)にアクセスします。

- APIキー作成メニューから新規キーを発行します。

- 発行したキーを一時的に安全な場所へ控えます。

APIキーはパスワードと同じ扱いです。公開ノートやスクリーンショットにキー文字列が写らないようにしてください。

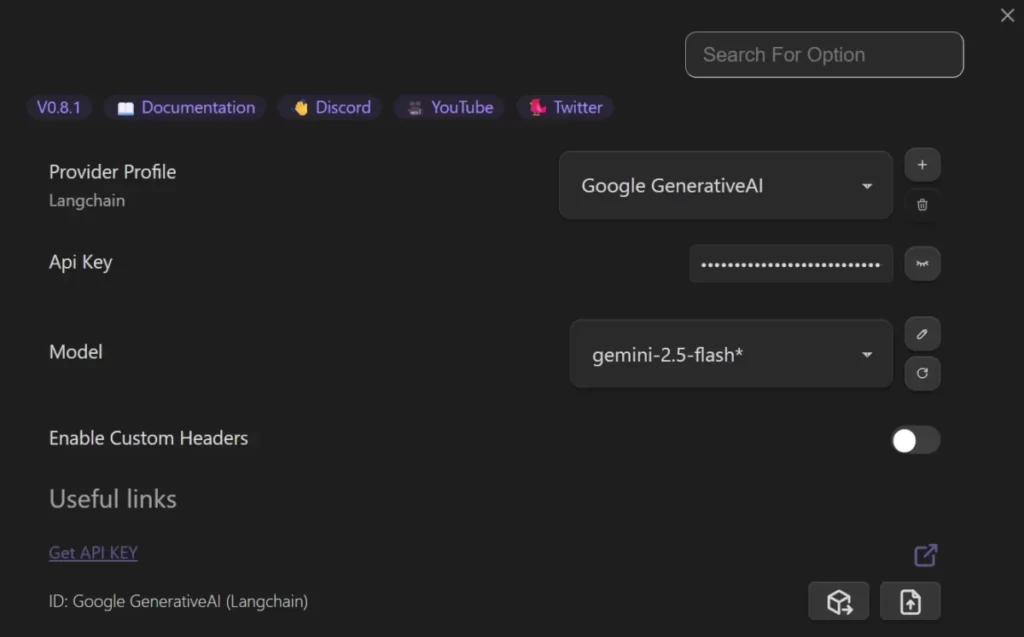

手順3: Text GeneratorにAPIキーを登録する

- Obsidianの

設定からText Generatorの設定を開きます。 Provider ProfileをGoogle GenerativeAI(またはGoogle系の項目)に設定します。API Key欄に取得したキーを貼り付けます。- 使用モデルを1つ選び、設定を保存します。

補足です。プラグインやAPIの更新で項目名が変わることがあります。

その場合は「Provider」「API Key」「Model」に相当する項目を探して設定してください。

Model は、プルダウンリストに掲載されたものによっては、「無料枠がない」、「すでに提供を終了している」といったエラーが表示されることがあります。

AIモデルは、日々更新されていくため、あくまでも記事作成時点(2026年3月19日)の情報になりますが、Model にgemini-2.5-flashと直接入力することで、私は使えましたので、うまくいかない場合は試してみてください。

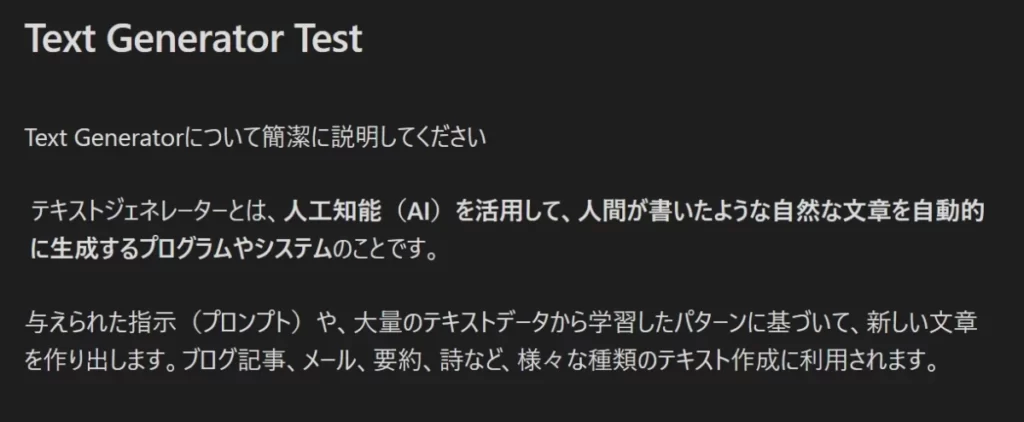

手順4: 1回だけ実行して接続確認する

- テスト用ノートを1枚作成します。

- 例として「Text Generatorについて簡潔に説明してください」と短い指示を入力します。

- Text Generatorの実行コマンドで生成し、応答が返るか確認します。

無料API枠で制限に当たったときの対処

無料APIで試していると、回数制限や時間帯制限で応答しない場面があります。

そのときは、次の順で切り分けると対処しやすいです。

- 数分待って再試行する

- プロンプトを短くして再実行する

- モデル設定を軽量モデルに切り替える

- 継続利用するなら有料APIへの移行を検討する

ここで重要なのは、いきなり「故障」と判断しないことです。

無料枠の制限は仕様として起こるため、まずは負荷を下げる方向で試すのが効率的です。

Text GeneratorとOllamaを連携する手順(ローカルLLM)

ここからは、API課金なしで使いたい方向けの手順です。

考え方は「先にOllama単体で動作確認」→「次にObsidian側へ接続」の順にすると安定します。

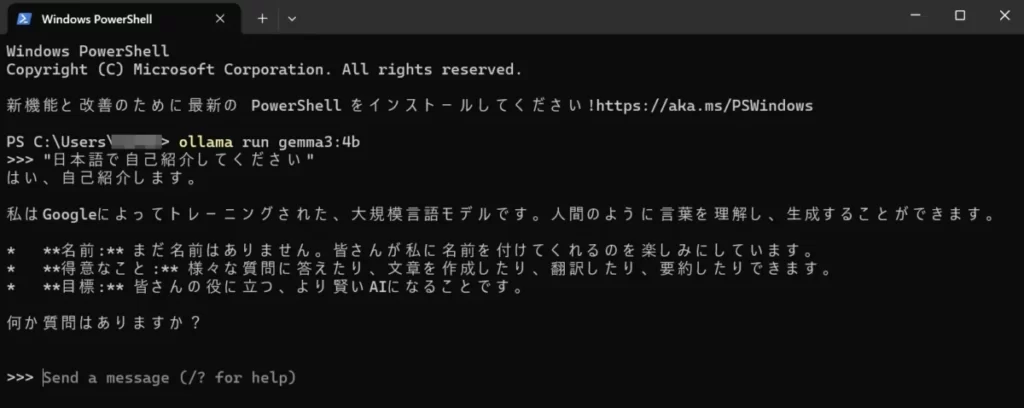

手順1: Ollamaでモデルを起動する

ここで紹介するPowerShellからのOllamaの起動は、初回の動作確認のためのものです。通常はPC起動時にOllamaが自動起動(常駐)するので、毎回、ObsidianのAIプラグインを使用する前に、PowerShellなどでOllamaを起動する必要はありません。

※黒い画面(PowerShell)での操作になりますが、以下のコマンドをそのままコピー&ペーストしてEnterを押すだけで大丈夫です。

ollama run gemma3:4b上のコマンドは、モデルを取得して対話実行する確認用コマンドです。

ここで応答が返れば、ローカルLLMの基本動作は問題ありません。

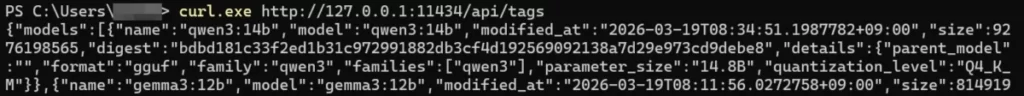

手順2: Ollama APIの待受を確認する

こちらも同じくPowerShellで実行します。1行をそのまま貼り付ければ問題ありません。

curl.exe http://127.0.0.1:11434/api/tagsこのコマンドは、OllamaがローカルAPIとして待ち受けているかを確認するためのものです。

モデル一覧のJSONが返ってくれば、Obsidianから接続できる前提が整っています。

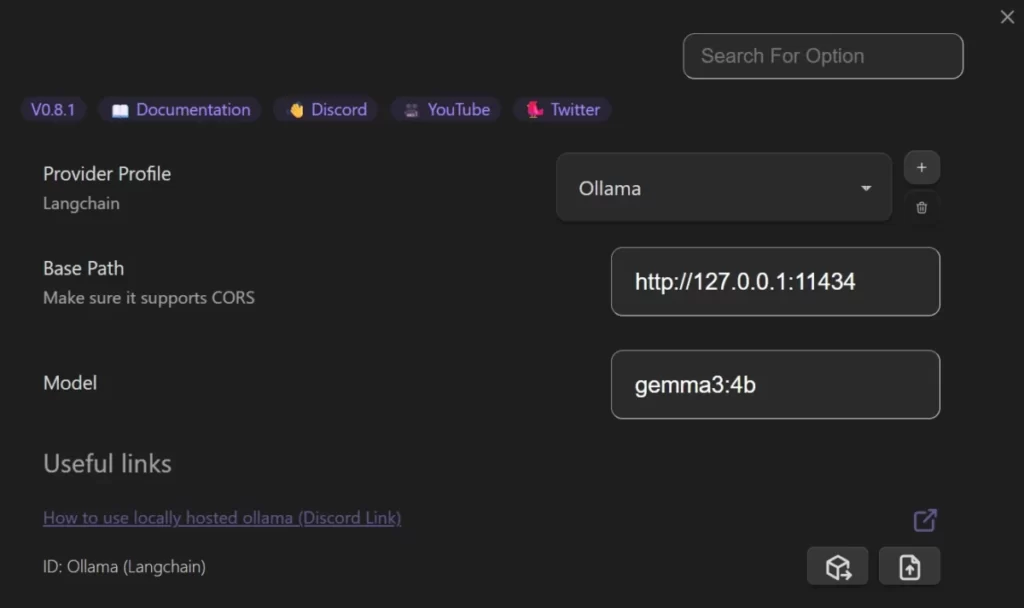

手順3: Text Generator側をローカル接続に切り替える

- Obsidianの

Text Generator設定を開きます。 Provider ProfileをOllamaに変更します。Base Pathにhttp://127.0.0.1:11434を設定します。- モデル名に

gemma3:4bなど、Ollamaで実際に存在するモデル名を入力します。 - 保存してから、短いプロンプトで1回生成します。

補足です。ここもバージョン差で項目名が変わることがあります。Base Path と Model を指定できる場所を探す、という見方で進めると迷いにくいです。

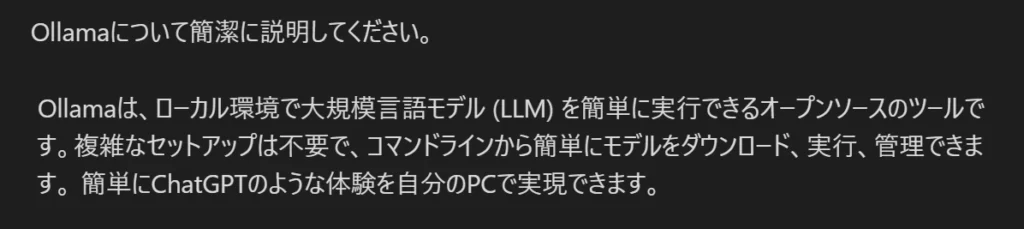

- 設定できたら、試しに使ってみましょう。

- 下の画像は、「Ollamaについて簡潔に説明してください。」というプロンプトを入力し、そこでText Generatorを実行した事例です。

手順4: 接続エラー時の最小チェック

接続できないときは、次の順で確認してください。

ollama runがこのPCで動くかBase Pathがhttp://127.0.0.1:11434になっているか- モデル名のスペルが一致しているか

- ファイアウォールやセキュリティソフトでブロックされていないか

ここまでで解決しない場合は、まずOllama単体の動作確認に戻ると切り分けしやすくなります。

よくある質問(FAQ)

Q1. 無料APIだけで運用し続けても問題ありませんか

軽い要約や短文の言い換え中心であれば、無料APIだけでも十分に実用的です。

ただし、利用量が増えると制限に当たりやすくなるため、継続運用では有料APIまたはローカルLLMの検討が現実的です。

Q2. 個人メモを外部へ送りたくない場合はどうすればよいですか

最優先ならローカルLLM運用が有力です。

クラウドAPIを使う場合でも、機密情報は送らない運用ルールを先に決めておくと安全性を高められます。

Q3. 最初に選ぶプラグインは何がよいですか

この第14回では接続方式の理解を優先しています。

次回の第15回で、目的別に使いやすいプラグイン候補をまとめて比較する予定です。

まとめ

今回は、Obsidianで生成AIを使う前提となる3つの接続方式を整理しました。

- 無料API枠は、低コストで始める最初の一歩として有効

- 有料APIは、品質と安定運用を重視する段階で強い

- ローカルLLMは、外部送信を抑えたい運用に向いている

私の実感としても、最初に接続方式の前提を整理しておくと、プラグイン選定や運用ルール作りで迷いにくくなります。

次回は、この前提知識を踏まえて、文章作成を支援する Text Generator や、ノート知識を横断参照できる Smart Connections など、目的別のおすすめObsidian向けAIプラグインを比較していきます。

コメント